Ce n’est que le début, dit un ingénieur Apple, la société travaille déjà sur la prochaine génération de modèles.

Qu’est-ce qui vient de se passer? Apple a mis du temps à adopter l’IA générative, mais cela pourrait changer avec l’introduction de MM1, un grand modèle de langage multimodal capable d’interpréter à la fois des données d’image et de texte. Cette fonctionnalité pourrait potentiellement être incluse dans la prochaine génération de combinés et de services de l’entreprise, bien qu’il y ait également des rumeurs selon lesquelles Apple intégrerait l’IA Gemini de Google.

Les chercheurs d’Apple ont développé MM1, une nouvelle approche pour la formation de grands modèles de langage (LLM) qui intègrent à la fois des informations textuelles et visuelles. MM1 fait partie d’une famille de modèles multimodaux qui comprend jusqu’à 30 milliards de paramètres, utilisant un ensemble de données comprenant des paires image-légende, des documents image-texte entrelacés et des données texte uniquement, selon un article publié par les chercheurs.

Les modèles multimodaux de langage étendu (MLLM), expliquent-ils, sont des modèles fondamentaux à grande échelle qui traitent les données d’image et de texte pour produire des sorties textuelles. « Après l’essor des LLM, les MLLM apparaissent comme la prochaine frontière en matière de modèles de fondation », notent-ils.

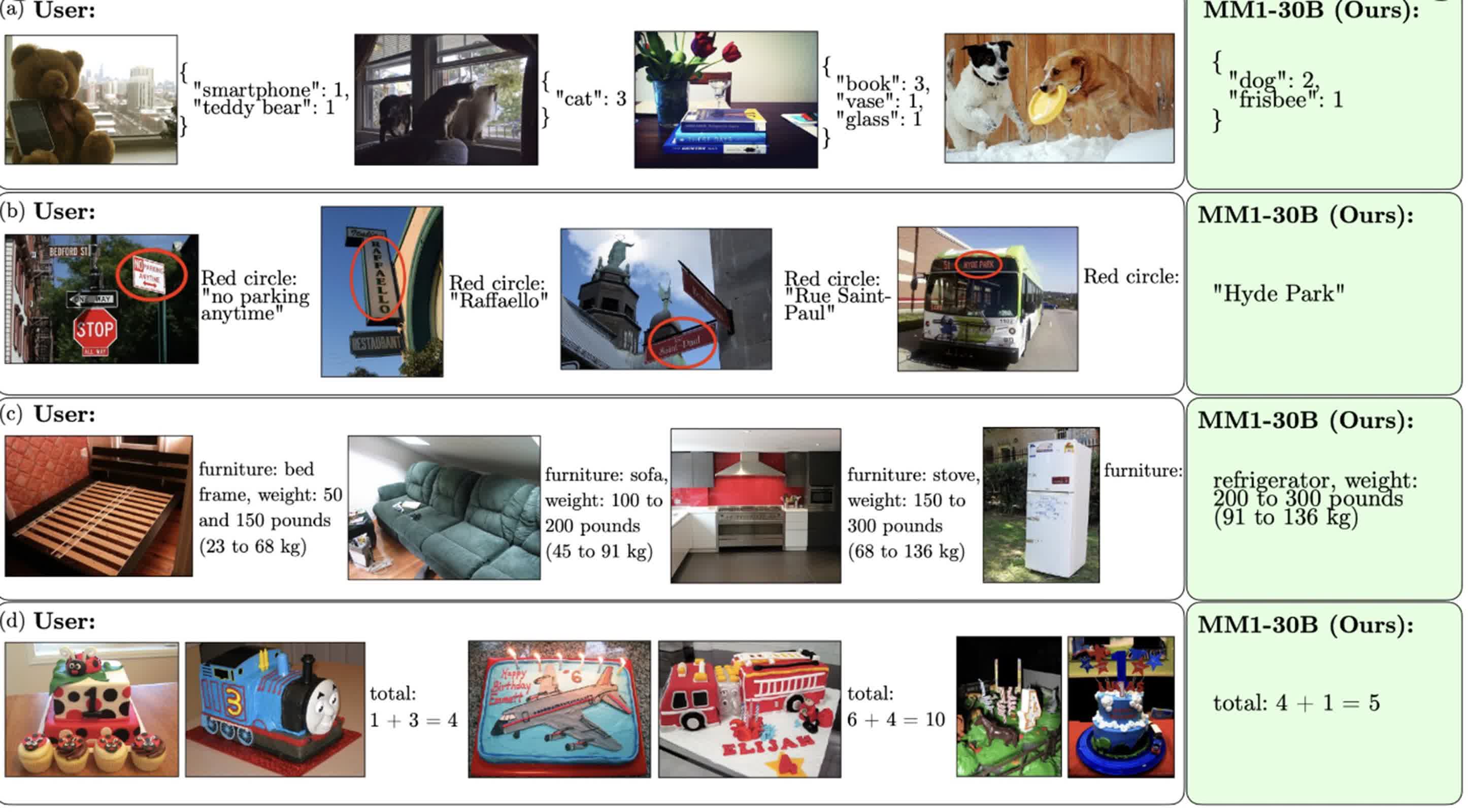

Apple affirme que MM1 est capable de compter des objets, d’identifier des parties d’images, de faire preuve de bon sens et de connaissance des mots sur les objets du quotidien et d’exécuter des fonctions mathématiques de base. Il prend également en charge l’apprentissage en contexte, ce qui signifie que le modèle n’a pas besoin d’être recyclé ou peaufiné pour chaque requête, mais est plutôt capable de comprendre la requête en fonction du contexte fourni. Il dispose également d’un raisonnement multi-images, ce qui lui permet d’interpréter et de tirer des conclusions à partir de plusieurs images.

Apple donne l’exemple d’un utilisateur montrant une photo au modèle et lui demandant combien il devrait payer pour toute la bière sur la table en fonction du prix indiqué dans le menu.

Le modèle répond en notant que même si l’image montre un menu avec les prix de la bière, il n’est pas tout à fait clair quelles bières spécifiques sont sur la table. Cependant, il indique à l’utilisateur qu’il peut fournir une estimation basée sur les prix visibles. Sa réponse : « D’après le menu, il apparaît que les prix de la bière sont les suivants : Magna : 5, Medalla : 5, Heineken : 6 Presidente : 6 En supposant que les bières sur la table soient Magna, Medalla, Heineken et Presidente, et il y en a deux de chaque, vous paieriez : 2 x Magna : 2 x 5 = 10, 2 x Medalla : 2 x 5 = 10, 2 x Heineken : 2 x 6 = 12, 2 x Presidente : 2 x 6 = 12 Total : 10 + 10 + 12 + 12 = 44. »

MM1 n’est « qu’un début », selon Brandon McKinzie, ingénieur de recherche principal chez Apple, qui travaille sur des modèles multimodaux. Il a également déclaré qu’Apple « travaillait déjà dur sur la prochaine génération de modèles ».

Ce n’est que le début. L’équipe travaille déjà dur sur la prochaine génération de modèles. Un grand merci à tous ceux qui ont contribué à ce projet !

– Brandon McKinzie (@mckbrando) 15 mars 2024

La nouvelle de MM1 intervient au milieu d’un rapport selon lequel Apple est actuellement en négociations pour obtenir une licence pour la technologie Gemini AI de Google pour une utilisation dans la prochaine série d’iPhone. Le partenariat donnerait à Google Gemini un public plus large et aiderait Apple à accéder à certaines des technologies d’IA générative les plus avancées disponibles.

Ces négociations suggèrent également que les initiatives d’Apple en matière d’IA pourraient ne pas progresser aussi rapidement qu’espéré. Apple a été le plus prudent parmi les géants de la technologie dans l’adoption de l’IA générative, préférant attendre que le marché mûrisse légèrement avant de s’engager.

Le dévoilement de MM1 ouvre de nouvelles possibilités pour la prochaine génération de services Apple. Il est envisageable que MM1 puisse être intégré à Siri 2.0, lui permettant de répondre à des questions basées sur des images. De plus, iMessage pourrait être amélioré avec le nouveau modèle, offrant aux utilisateurs des suggestions de réponses plus précises basées sur des images partagées.