La Russie tente de saper le soutien américain à l’Ukraine et à l’OTAN

En bref: La Russie mène une fois de plus des campagnes en ligne pour tenter de manipuler les élections présidentielles aux États-Unis, bien qu’à un rythme plus lent que celui observé lors des élections précédentes. Microsoft écrit que le pays tente principalement de saper le soutien du public américain à l'Ukraine et à l'OTAN.

La campagne d'influence électorale russe aux États-Unis s'est accélérée au cours des deux derniers mois, écrit Microsoft, mais la saison primaire moins contestée signifie qu'elle n'a pas été aussi intense qu'en 2016 et 2020.

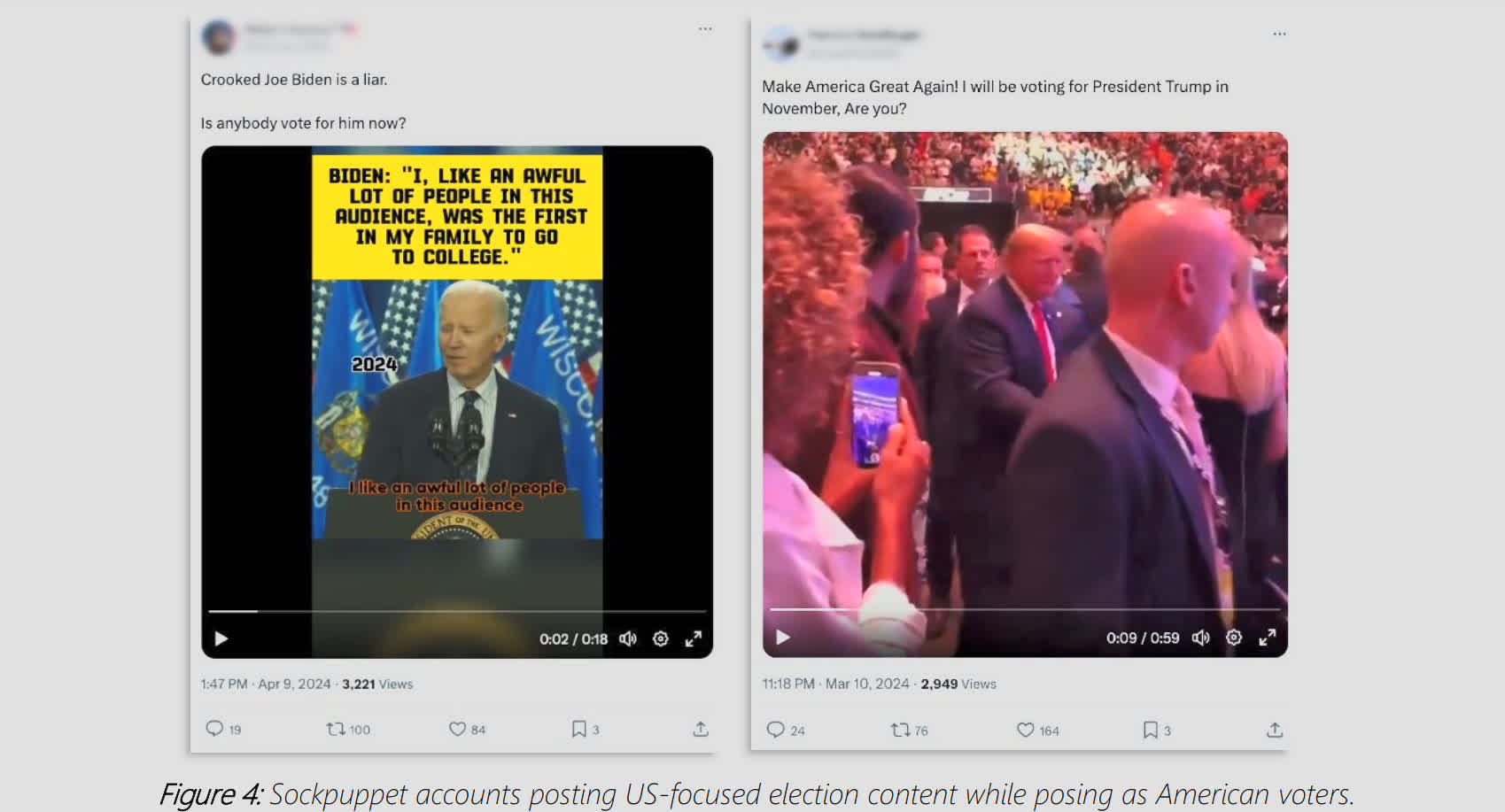

L'objectif principal de la campagne russe est de répandre le soutien à sa guerre en Ukraine par la désinformation, en réduisant le soutien à l'OTAN et en provoquant des luttes intestines au sein des États-Unis, en utilisant les médias traditionnels et sociaux et un mélange de campagnes secrètes et ouvertes.

Microsoft écrit que le groupe Storm-1516, affilié à la Russie, diffuse un message anti-Ukraine en créant une vidéo de quelqu'un se présentant comme un lanceur d'alerte ou un journaliste citoyen diffusant un récit positif pour la Russie sur la guerre. La vidéo est ensuite couverte par un réseau mondial apparemment non affilié de sites Web gérés secrètement, notamment DC Weekly et The Intel Drop, avant d'être amplifiée par des expatriés russes, des responsables et des compagnons de voyage. Le public américain répète et republie ensuite la désinformation, probablement sans en connaître la source.

Un autre groupe mis en avant par Microsoft est Star Blizzard, alias Cold River. Il se concentre sur les groupes de réflexion occidentaux et, même s’il n’a toujours aucun lien avec les élections de 2024, son attention sur les personnalités politiques américaines pourrait être la première d’une série de campagnes de piratage conçues pour obtenir des résultats favorables au Kremlin d’ici novembre.

De nombreuses inquiétudes ont été soulevées concernant l’utilisation par des adversaires étrangers d’une IA avancée pour influencer les élections américaines. Microsoft a déclaré que l'utilisation généralisée de vidéos deepfake n'a pas encore été observée, mais que les faux contenus audio et améliorés par l'IA auront probablement plus de succès.

Microsoft écrit que le contenu amélioré par l'IA a plus d'influence que le contenu entièrement généré par l'IA, que l'audio de l'IA a plus d'impact que la vidéo de l'IA et que le faux contenu prétendant provenir d'un environnement privé tel qu'un appel téléphonique est plus efficace que le faux contenu provenant d'un environnement public. . La société ajoute que les imitations de personnes moins connues fonctionnent mieux que les imitations de personnes bien connues telles que des dirigeants mondiaux.

Nous avons déjà vu des exemples de faux sons utilisés pour influencer les gens. Un appel automatisé de 39 secondes a été envoyé aux électeurs du New Hampshire en janvier pour leur demander de ne pas voter aux élections primaires démocrates, mais de « conserver leurs votes » pour l'élection présidentielle de novembre. La voix qui donnait ce conseil était un modèle généré par l’IA qui ressemblait presque exactement à celui de Joe Biden. Cela a conduit la FCC à rendre illégaux les appels automatisés générés par l’IA et Biden à appeler à l’interdiction des usurpations d’identité vocales par l’IA.

La Russie n’est pas la seule à chercher à perturber et à influencer les élections américaines en utilisant l’IA. Microsoft a averti plus tôt ce mois-ci que les campagnes chinoises continuaient d'affiner le contenu généré ou amélioré par l'IA, en créant des vidéos, des mèmes et de l'audio, entre autres, pour créer des publications sur les réseaux sociaux axées sur des sujets politiquement controversés.

En février, 20 grandes entreprises, dont Amazon, Google, Meta et X, ont signé un accord s'engageant à éliminer les contenus deepfake et génératifs d'IA conçus pour influencer ou interférer avec le droit de vote démocratique des citoyens.