Les deepfakes « peuvent causer un préjudice émotionnel, financier et réputationnel irrévocable », a déclaré un représentant.

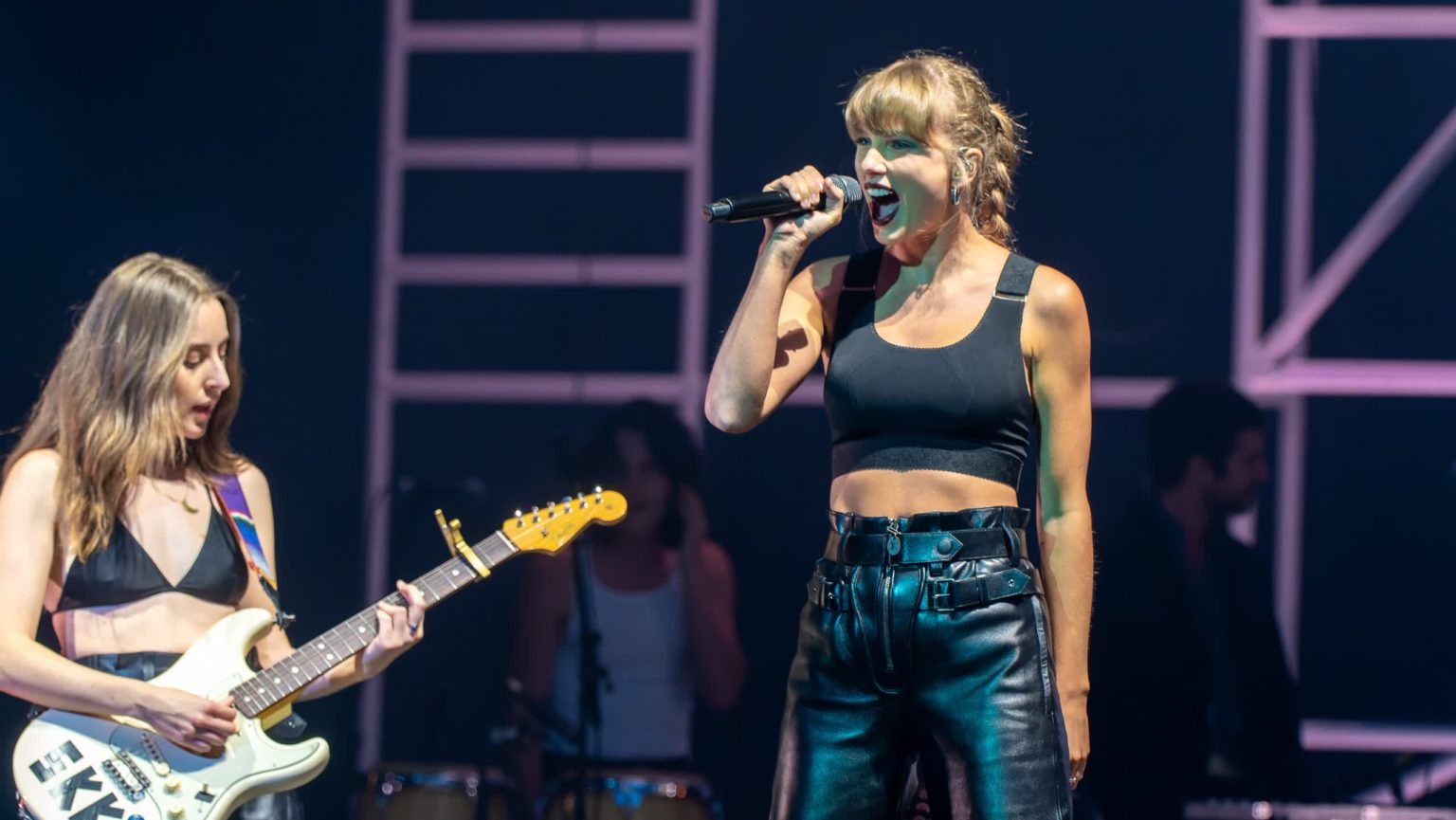

TL;DR : La pop star de renommée mondiale Taylor Swift est devenue cette semaine la dernière victime de la pornographie deepfake, après que des images d’elle générées par l’IA ont été partagées des dizaines de millions de fois sur les plateformes de médias sociaux. Avec cela, les deepfakes sont de retour dans la conscience législative. Les représentants du Congrès et même de la Maison Blanche se sont désormais prononcés sur la question.

Des images explicites de l’auteur-compositeur-interprète Taylor Swift, 34 ans, ont été partagées sur X cette semaine, recueillant plus de 27 millions de vues et 260 000 « j’aime » avant la fermeture du compte qui a publié les images. Cela n’a cependant pas empêché la propagation, puisque les images ont continué à circuler et auraient été vues plus de 40 millions de fois.

En réponse à l’incident, X a activement supprimé les images et a désactivé les recherches de Taylor Swift sur la plateforme pour tenter de contenir la propagation. Dans un communiqué, il a déclaré : « Nous surveillons de près la situation pour garantir que toute nouvelle violation soit immédiatement corrigée et que le contenu soit supprimé. »

Mais la modération sur la plateforme n’est peut-être pas suffisante. Aujourd’hui, des membres du Congrès américain et même de la Maison Blanche se sont prononcés sur la question. Le représentant américain Joe Morelle a déclaré que les images deepfakes « peuvent causer des dommages irrévocables sur le plan émotionnel, financier et à la réputation – et malheureusement, les femmes sont touchées de manière disproportionnée ».

La représentante démocrate Yvette Clark a déclaré : « Ce qui est arrivé à Taylor Swift n’est pas nouveau. Pendant des années, les femmes ont été la cible de deepfakes (sans) leur consentement. Et (avec) les progrès de l’IA, créer des deepfakes est plus facile et moins cher. »

Vendredi, la secrétaire de presse de la Maison Blanche, Karine Jean-Pierre, a qualifié ces images d' »alarmantes » et a déclaré dans un communiqué : « Alors que les sociétés de médias sociaux prennent leurs propres décisions indépendantes en matière de gestion de contenu, nous pensons qu’elles ont un rôle important à jouer dans l’application des règles ». leurs propres règles pour empêcher la propagation de la désinformation et des images intimes et non consensuelles de personnes réelles. »

Ce qui est arrivé à Taylor Swift n’a rien de nouveau. Depuis des années, les femmes sont la cible de deepfakes sans leur consentement. Et grâce aux progrès de l’IA, créer des deepfakes est plus facile et moins cher.

C’est un problème des deux côtés de l’allée et même les Swifties devraient pouvoir s’unir pour le résoudre.

– Yvette D. Clarke (@RepYvetteClarke) 25 janvier 2024

Comme l’a déclaré le représentant Clark, il ne s’agit pas d’un problème nouveau. Mais avec une cible aussi médiatisée, le problème a traversé le discours public et pourrait désormais constituer une cible possible pour une future législation.

Au Royaume-Uni, les deepfakes explicites ont été rendus illégaux en vertu de la loi sur la sécurité en ligne en octobre 2023. PornHub, un important fournisseur en ligne de médias pour adultes, interdit les deepfakes sur sa plateforme depuis 2018.

Mme Swift n’a pas encore commenté publiquement l’incident.

Que ce dernier incident très médiatisé entraîne ou non des changements législatifs, il est clair que le contenu de l’IA pose déjà des problèmes aux législateurs. Cette semaine encore, nous avons signalé le premier cas connu d’utilisation de messages générés par l’IA pour supprimer la participation électorale, après qu’un faux président Biden a appelé les habitants du New Hampshire et les a exhortés à ne pas voter.