L’ère de l’IA est à nos portes et Nvidia souhaite qu’elle soit alimentée par ses cartes GeForce RTX

Une patate chaude : Nvidia a jusqu’à présent dominé le secteur des accélérateurs d’IA sur le marché des serveurs et des centres de données. Désormais, la société améliore ses offres logicielles pour offrir une expérience d’IA améliorée aux utilisateurs de GeForce et d’autres GPU RTX sur les systèmes de bureau et de postes de travail.

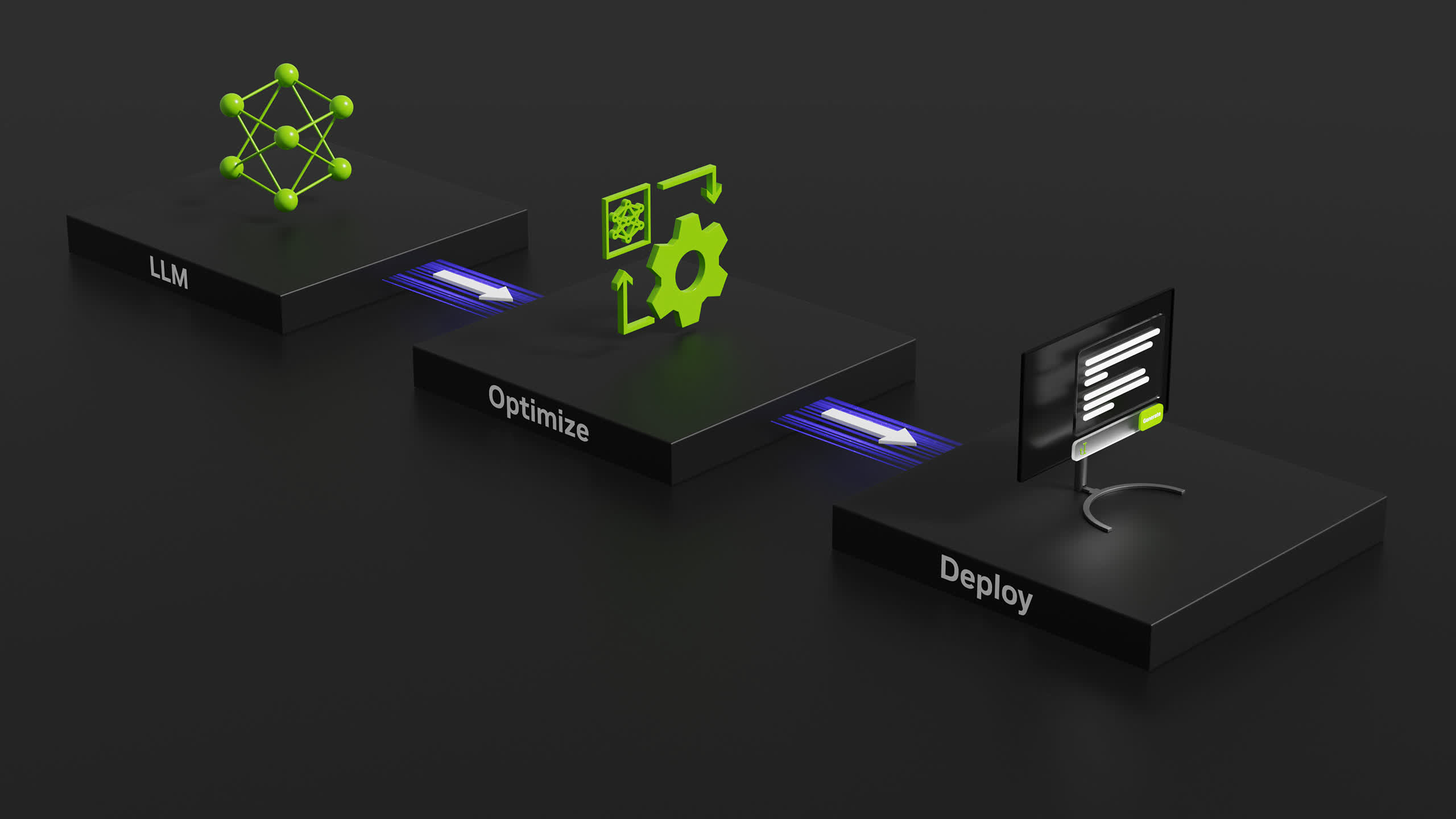

Nvidia lancera bientôt TensorRT-LLM, une nouvelle bibliothèque open source conçue pour accélérer les algorithmes d’IA générative sur GeForce RTX et les GPU RTX professionnels. Les dernières puces graphiques de la société Santa Clara incluent des processeurs d’IA dédiés appelés Tensor Cores, qui fournissent désormais une accélération matérielle native de l’IA à plus de 100 millions de PC et postes de travail Windows.

Sur un système équipé de RTX, TensorRT-LLM peut apparemment fournir des performances d’inférence jusqu’à 4 fois plus rapides pour les modèles de langage étendu (LLM) d’IA les plus récents et les plus avancés comme Llama 2 et Code Llama. Alors que TensorRT a été initialement publié pour les applications de centres de données, il est désormais disponible pour les PC Windows équipés de puissantes puces graphiques RTX.

Les LLM modernes stimulent la productivité et sont au cœur des logiciels d’IA, comme l’a noté Nvidia. Grâce à TensorRT-LLM (et à un GPU RTX), les LLM peuvent fonctionner plus efficacement, ce qui se traduit par une expérience utilisateur considérablement améliorée. Les chatbots et les assistants de code peuvent produire simultanément plusieurs résultats de saisie semi-automatique uniques, permettant aux utilisateurs de sélectionner la meilleure réponse à partir du résultat.

La nouvelle bibliothèque open source est également bénéfique lors de l’intégration d’un algorithme LLM avec d’autres technologies, comme l’a noté Nvidia. Ceci est particulièrement utile dans les scénarios de génération augmentée par récupération (RAG) dans lesquels un LLM est combiné avec une bibliothèque de vecteurs ou une base de données. Les solutions RAG permettent à un LLM de générer des réponses basées sur des ensembles de données spécifiques (tels que les e-mails des utilisateurs ou les articles de sites Web), permettant des réponses plus ciblées et pertinentes.

Nvidia a annoncé que TensorRT-LLM sera bientôt disponible en téléchargement via le site Web Nvidia Developer. La société propose déjà des modèles TensorRT optimisés et une démo RAG avec les actualités GeForce sur ngc.nvidia.com et GitHub.

Alors que TensorRT est principalement conçu pour les professionnels et les développeurs de l’IA générative, Nvidia travaille également sur des améliorations supplémentaires basées sur l’IA pour les clients GeForce RTX traditionnels. TensorRT peut désormais accélérer la génération d’images de haute qualité à l’aide de la diffusion stable, grâce à des fonctionnalités telles que la fusion de couches, l’étalonnage de précision et le réglage automatique du noyau.

En plus de cela, les cœurs Tensor des GPU RTX sont utilisés pour améliorer la qualité des flux vidéo Internet de faible qualité. RTX Video Super Resolution version 1.5, incluse dans la dernière version des pilotes graphiques GeForce (version 545.84), améliore la qualité vidéo et réduit les artefacts dans le contenu lu en résolution native, grâce à la technologie avancée de « traitement des pixels AI ».