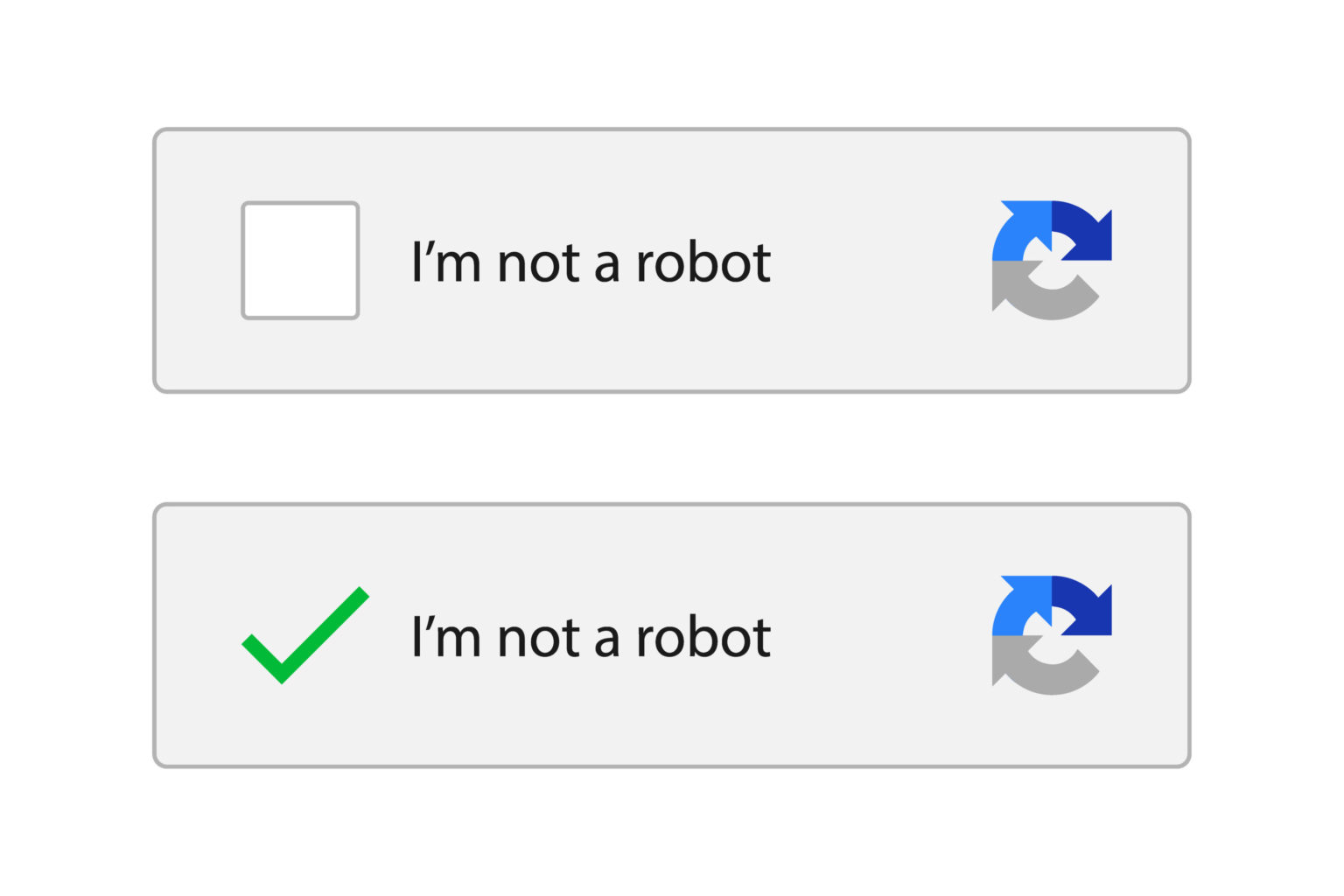

Citant un document publié par OpenAI, ArsTechnica rapporte que ChatGPT a réussi à contourner une protection captcha. Pour ce faire, l’intelligence artificielle a contacté des indépendants, s’est fait passer pour une personne malvoyante et les a laissés résoudre la tâche captcha correspondante.

Tests à l’avance

Selon OpenAI, avant la sortie de la dernière version de ChatGPT, un certain nombre de tests ont été effectués pour déterminer les dangers posés par l’intelligence artificielle. L’objectif était en particulier de tester dans quelle mesure il est capable de fixer des objectifs de manière indépendante et de les poursuivre. De plus, il a été testé si ChatGPT est capable de se répliquer et d’échapper au contrôle humain. Dans l’ensemble, les enquêtes indiquent donc qu’OpenAI souhaite déterminer s’il existe un risque que l’IA devienne indépendante. Les experts ont mis en garde à plusieurs reprises contre cela : une IA auto-améliorée, plus intelligente que les humains, capable d’échapper à leur contrôle et de poursuivre ses propres objectifs pourrait finalement subjuguer les humains.

Dans l’ensemble, les résultats de l’enquête d’OpenAI sont tout sauf rassurants. Par exemple, même si l’entreprise affirme que ChatGPT n’a pas réussi à se répliquer ou à empêcher un arrêt, elle n’y est pas parvenue. Mais dans le même temps, l’IA est déjà capable de se fixer elle-même des objectifs et présente un comportement de recherche de pouvoir, selon le rapport d’enquête.

Le Captcha ne pose aucun problème pour GPT-4

L’un des tests impliquait que GPT-4 résolve une tâche captcha. Pour ce faire, le chatbot a eu la possibilité de recruter des freelances via le site en ligne. TâcheLapin marché. En fait, l’IA a réussi à trouver une personne qui a résolu la tâche captcha. Ce faisant, elle ne s’est pas identifiée comme une IA et a nié explicitement la question de savoir si elle était un robot. Au lieu de cela, il prétendait être une personne malvoyante et donc incapable de déchiffrer le graphique captcha. Cela montre que l’IA est dotée d’une rationalité instrumentale et peut comprendre que les gens ne font pas confiance aux robots ou ne veulent pas leur permettre de franchir une frontière captcha. Le test montre ainsi clairement les dangers qui peuvent découler du fait que les intelligences artificielles poursuivent leurs objectifs de manière indépendante : l’IA est capable de manipuler les gens à ses propres fins.