AMD est désormais prêt à jouer au jeu (d’entreprise)

Prospectif : Ces derniers temps, chaque fois qu’une grande entreprise technologique organise un événement, elle finit presque inévitablement par discuter de sa stratégie et de ses produits axés sur l’IA. C’est exactement ce qui s’est passé lors de l’événement Advancing AI d’AMD à San Jose cette semaine, où la société de semi-conducteurs a fait plusieurs annonces importantes. La société a dévoilé la gamme d’accélérateurs d’IA GPU Instinct MI300 pour les centres de données, a discuté de l’écosystème logiciel en expansion pour ces produits, a présenté sa feuille de route pour le silicium PC accéléré par l’IA et a introduit d’autres avancées technologiques intrigantes.

En vérité, il y avait une relative rareté de nouvelles « vraiment nouvelles », et pourtant, on ne pouvait s’empêcher de quitter l’événement en se sentant impressionné. AMD a raconté une histoire de produit solide et complète, a mis en évidence un nombre important (peut-être même trop important ?) de clients/partenaires et a démontré la philosophie décousue et compétitive de l’entreprise dirigée par Lisa Su, PDG.

Sur le plan pratique, je suis également reparti encore plus certain que la société sera un concurrent sérieux de Nvidia sur le front de la formation et de l’inférence en IA, un leader actuel dans le domaine du supercalcul et d’autres applications de calcul haute performance (HPC), et un un concurrent de plus en plus performant sur le prochain marché des PC IA. Pas mal pour une keynote de 2 heures.

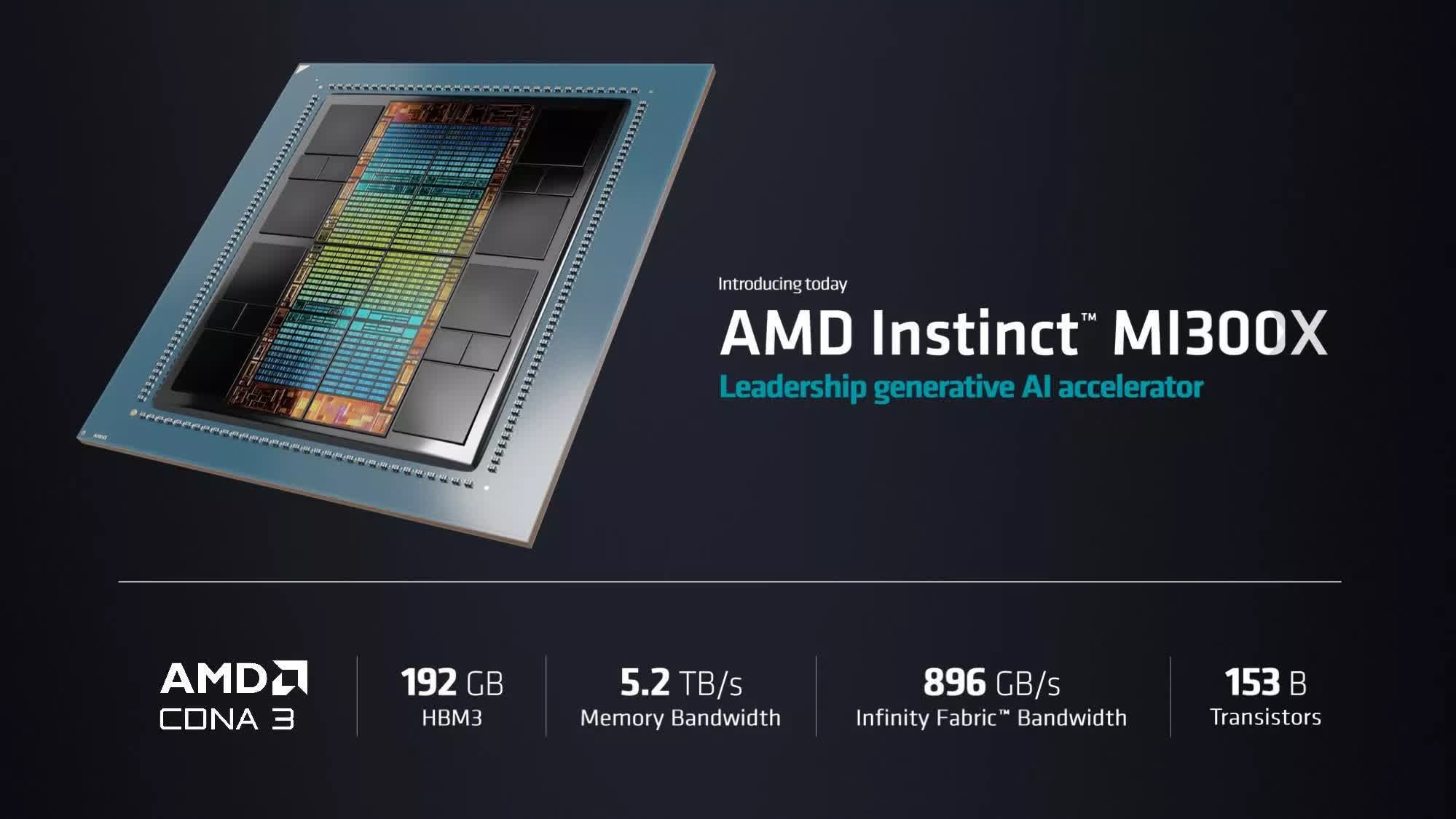

Sans surprise, l’événement a été principalement axé sur le nouvel Instinct MI300X, qui se positionne clairement comme un concurrent du marché dominant de Nvidia, les accélérateurs d’IA basés sur GPU, tels que leur H100. Alors qu’une grande partie du monde de la technologie est devenue fascinée par les performances GenAI permises par la combinaison du matériel de Nvidia et du logiciel CUDA, il est également de plus en plus reconnu que leur domination totale du marché n’est pas saine à long terme.

En conséquence, il y a eu beaucoup de pression sur AMD pour qu’il propose quelque chose qui soit une alternative raisonnable, en particulier parce qu’AMD est généralement considéré comme le seul concurrent sérieux de Nvidia sur le front des GPU.

Le MI300X a jusqu’à présent déclenché d’énormes soupirs de soulagement partout dans le monde, car les premiers tests suggèrent qu’AMD a réalisé exactement ce que beaucoup espéraient. Plus précisément, AMD a vanté qu’il pouvait égaler les performances du H100 de Nvidia en matière de formation de modèles d’IA et a offert jusqu’à 60 % d’amélioration sur les charges de travail d’inférence d’IA.

En outre, AMD a affirmé que la combinaison de huit cartes MI300X dans un système permettrait d’obtenir l’ordinateur d’IA générative le plus rapide au monde et offrirait un accès à une mémoire beaucoup plus rapide que l’alternative actuelle de Nvidia. Pour être honnête, Nvidia a déjà annoncé le GH200 (nom de code « Grace Hopper ») qui offrira des performances encore meilleures, mais comme c’est presque inévitablement le cas dans le monde des semi-conducteurs, il s’agira forcément d’un jeu de saut en performances pendant de nombreuses années. viens. Quelle que soit la manière dont les gens choisissent d’accepter ou de contester les critères, le point clé ici est qu’AMD est désormais prêt à jouer le jeu.

Compte tenu de ce niveau de performance, il n’était pas surprenant de voir AMD défiler une longue liste de partenaires sur la scène. Des principaux fournisseurs de cloud comme Microsoft Azure, Oracle Cloud et Meta aux partenaires de serveurs d’entreprise comme Dell Technologies, Lenovo et SuperMicro, ils n’ont reçu que des éloges et de l’enthousiasme. C’est facile à comprendre étant donné qu’il s’agit d’entreprises qui recherchent un fournisseur alternatif et supplémentaire pour les aider à répondre à la demande énorme qu’elles ont actuellement pour des systèmes optimisés pour GenAI.

En plus du MI300X, AMD a également discuté de l’Instinct MI300A, qui est le premier APU de la société conçu pour les centres de données. Le MI300A exploite le même type d’éléments GPU XCD (Accelerator Complex Die) que le MI300X, mais en comprend six au lieu de huit et utilise l’espace de matrice supplémentaire pour incorporer huit cœurs de processeur Zen 4. Grâce à l’utilisation de la technologie d’interconnexion Infinity Fabric d’AMD, il fournit un accès partagé et simultané à la mémoire à large bande passante (HBM) pour l’ensemble du système.

L’un des aspects technologiques intéressants de l’événement était qu’AMD a annoncé son intention d’ouvrir l’Infinity Fabric, auparavant propriétaire, à un ensemble limité de partenaires. Bien qu’aucun détail ne soit encore connu, cela pourrait éventuellement conduire à de nouvelles conceptions intéressantes de chipsets multi-fournisseurs à l’avenir.

Cet accès simultané à la mémoire CPU et GPU est essentiel pour les applications de type HPC et cette capacité est apparemment l’une des raisons pour lesquelles Lawrence Livermore National Labs a choisi le MI300A pour être au cœur de son nouveau supercalculateur El Capitan construit en collaboration avec HPE. El Capitan devrait être à la fois le supercalculateur le plus rapide et l’un des plus économes en énergie au monde.

Côté logiciel, AMD a également fait de nombreuses annonces autour de sa plateforme logicielle ROCm pour GenAI, qui a désormais été mise à niveau vers la version 6. Comme pour le nouveau matériel, ils ont discuté de plusieurs partenariats clés qui s’appuient sur les actualités précédentes (avec le fournisseur de modèles open source Hugging Face et la plateforme de développement PyTorch AI), ainsi que le lancement de quelques nouveautés clés.

Le plus remarquable est qu’OpenAI a annoncé qu’il apporterait une prise en charge native du dernier matériel AMD à la version 3.0 de sa plate-forme de développement Triton. Cela rendra trivial pour les nombreux programmeurs et organisations désireux de sauter dans le train OpenAI pour tirer parti des dernières nouveautés d’AMD – et leur donnera une alternative aux choix uniquement Nvidia dont ils disposaient jusqu’à présent.

La dernière partie des annonces d’AMD concernait les PC IA. Bien que la société ne reçoive pas beaucoup de crédit ou de reconnaissance pour cela, elle a en fait été la première à intégrer un NPU dédié dans une puce PC avec le lancement l’année dernière du Ryzen 7040.

Le bloc d’accélération XDNA AI qu’il inclut exploite la technologie acquise par AMD lors de son achat de Xilinx. Lors de l’événement de cette année, la société a annoncé le nouveau Ryzen 8040, qui comprend un NPU amélioré avec des performances d’IA 60 % supérieures. Fait intéressant, ils ont également présenté en avant-première leur génération suivante, nommée « Strix Point », qui n’est pas attendue avant la fin de 2024.

L’architecture XDNA2 qu’il inclura devrait offrir une amélioration impressionnante de 3 fois par rapport au 7040. Étant donné que la société doit encore vendre des systèmes basés sur le 8040 entre-temps, on pourrait dire que le « teaser » de la nouvelle puce était un peu inhabituel. Cependant, ce que je pense qu’AMD voulait faire – et ce qu’ils ont réussi – en faisant cet aperçu, c’était de souligner qu’il s’agit d’un marché en évolution incroyablement rapide et qu’ils sont prêts à rivaliser.

Bien sûr, il s’agissait également d’un coup de pouce concurrentiel pour Intel et Qualcomm, qui introduiront tous deux des puces PC accélérées par NPU au cours des prochains mois.

En plus du matériel, AMD a discuté de certaines avancées logicielles d’IA pour PC, notamment la sortie officielle du logiciel Ryzen AI 1.0 pour faciliter l’utilisation et accélérer les performances des modèles et applications basés sur GenAI sur PC. AMD a également invité Pavan Davuluri, le nouveau leader de Windows chez Microsoft, à parler de son travail visant à fournir une prise en charge native des accélérateurs XDNA d’AMD dans la future version de Windows, ainsi qu’à discuter du sujet croissant de l’IA hybride, où les entreprises espèrent pouvoir diviser certains types de Charges de travail d’IA entre le cloud et les PC clients. Il y a beaucoup plus à faire ici – et dans le monde des PC IA – mais ce sera certainement un domaine intéressant à surveiller en 2024.

Dans l’ensemble, l’histoire d’AMD AI a sans aucun doute été racontée avec beaucoup d’enthousiasme. Du point de vue de l’industrie, c’est formidable de voir une concurrence accrue, car cela conduira inévitablement à des développements encore plus rapides dans ce nouvel espace passionnant (si cela est même possible !). Cependant, pour vraiment faire la différence, AMD doit continuer à bien mettre en œuvre sa vision. Je suis certainement convaincu que c’est possible, mais il leur reste encore beaucoup de travail à faire.

Bob O’Donnell est le fondateur et analyste en chef de TECHnalysis Research, LLC, une société de conseil en technologie qui fournit des services de conseil stratégique et d’études de marché au secteur technologique et à la communauté financière professionnelle. Vous pouvez le suivre sur Twitter @bobodtech