Ils disent que son décret ne va pas assez loin

En bref: Plusieurs groupes de défense ont écrit une lettre ouverte au président Biden et à son administration, soulignant leurs inquiétudes quant au manque d’action face à la quantité massive d’énergie utilisée par les outils d’IA générative et à leur capacité à créer de la désinformation liée à l’environnement.

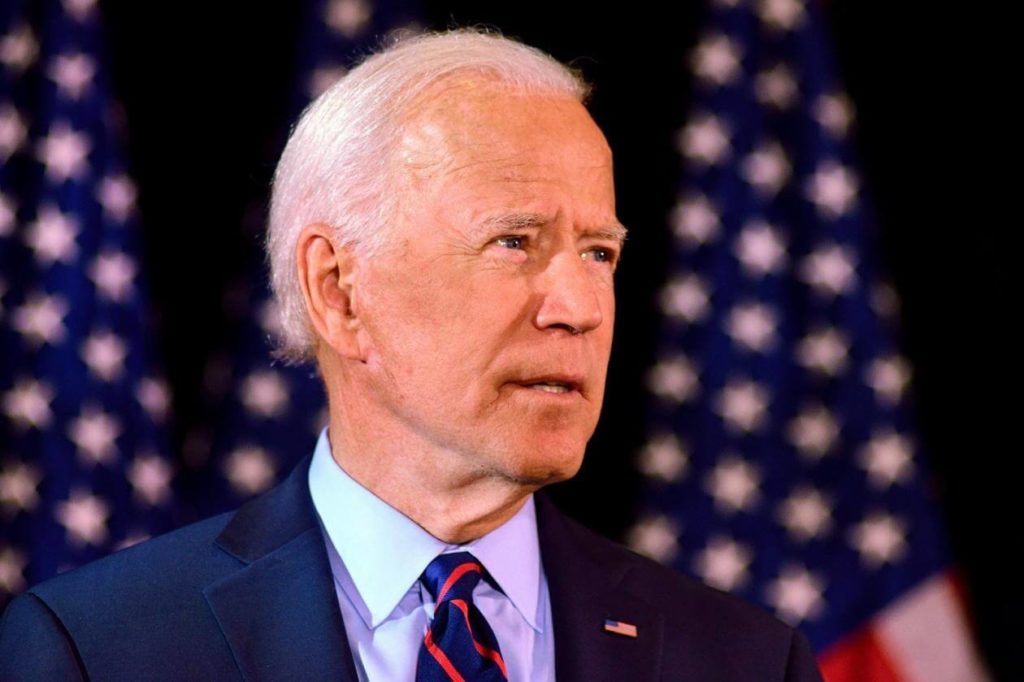

En octobre dernier, l’administration Biden a tenté de résoudre la question difficile de la réglementation du développement de l’intelligence artificielle avec un décret signé par le président qui promettait de gérer les risques liés à la technologie. L’ordonnance couvre de nombreux domaines, notamment l’impact de l’IA sur l’emploi, la confidentialité, la sécurité, etc. Il mentionne également l’utilisation de l’IA pour améliorer le réseau national et examiner les études environnementales pour aider à lutter contre le changement climatique.

Dix-sept groupes, dont Greenpeace USA, le Tech Oversight Project, les Amis de la Terre, Amazon Employees for Climate Justice et l’Electronic Privacy Information Center (EPIC), ont écrit dans une lettre ouverte à Biden que le décret ne fait pas assez pour résoudre le problème. l’impact environnemental de la technologie, à la fois littéralement et par la désinformation.

« … en raison de leurs énormes besoins énergétiques et de l’empreinte carbone associée à leur croissance et à leur prolifération, l’utilisation généralisée des LLM peut augmenter les émissions de carbone », indique la lettre.

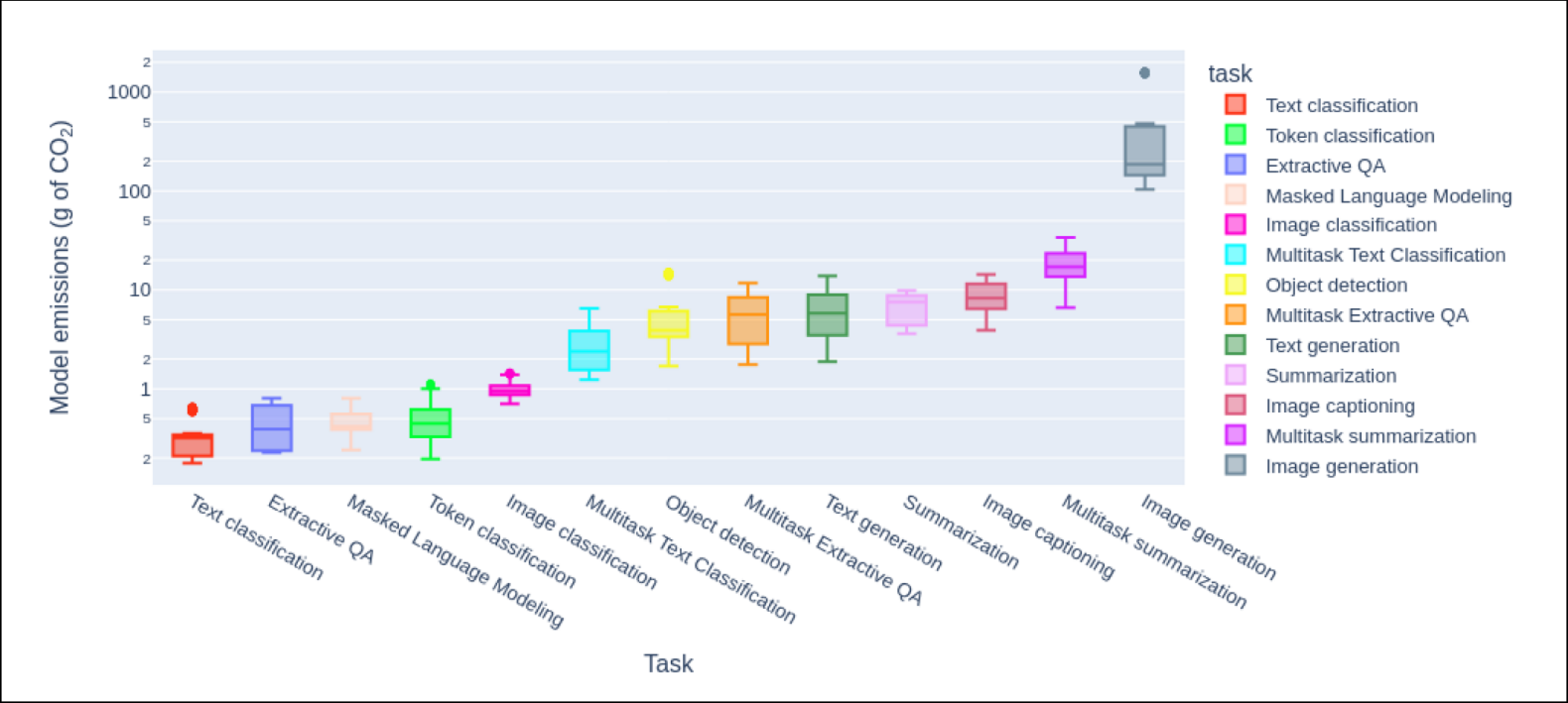

Une étude récemment publiée par la startup d’IA Hugging Face et l’Université Carnegie Mellon a mis en évidence la quantité massive d’énergie utilisée par les modèles d’IA générative, à la fois pendant leur phase de formation et dans leurs applications quotidiennes fréquentes. L’utilisation de Stable Diffusion XL pour générer 1 000 images entraîne la même quantité d’émissions de carbone que la conduite d’une voiture à essence moyenne sur 4,1 miles.

« Un battage médiatique infondé en provenance de la Silicon Valley affirme que l’IA peut sauver la planète dans le futur, mais les recherches montrent que c’est le contraire qui se produit actuellement », ont écrit les groupes.

Outre leurs inquiétudes quant à l’impact de l’IA sur la planète, les groupes ont également exprimé leurs inquiétudes quant à son utilisation potentielle pour diffuser la désinformation climatique.

« L’IA générative menace d’amplifier les types de désinformation climatique qui ont tourmenté l’ère des médias sociaux et ralenti les efforts de lutte contre le changement climatique. » ils ont écrit. « Les chercheurs ont pu facilement contourner les garanties de ChatGPT pour produire un article du point de vue d’un négationniste du changement climatique, affirmant que les températures mondiales diminuaient réellement. »

Nous avons déjà vu l’IA générative être utilisée pour créer de la désinformation sur les prochaines élections américaines et dans plusieurs autres domaines, où le principal défi consiste souvent à convaincre les gens que le contenu généré n’est pas réel.

Les groupes souhaitent que le gouvernement oblige les entreprises à rendre compte publiquement de la consommation d’énergie et des émissions produites par le cycle de vie complet des modèles d’IA, y compris la formation, la mise à jour et les requêtes de recherche. Ils demandent également une étude sur l’effet que les systèmes d’IA peuvent avoir sur la désinformation climatique et la mise en œuvre de garanties contre sa production. Enfin, il est demandé aux entreprises d’expliquer au grand public comment les modèles d’IA générative produisent des informations, mesurent la précision du changement climatique et les sources de preuves pour leurs affirmations.