Pas encore de mot sur les GPU de jeu de nouvelle génération

Prospectif : Lundi, lors de la conférence GTC 2024 de Nvidia, la société a dévoilé sa plate-forme GPU Blackwell qui, selon elle, est conçue pour le traitement génératif de l’IA. La gamme de nouvelle génération comprend le GPU B200 et la « superpuce » GB200 Grace qui offrent toute la puissance nécessaire aux charges de travail d’inférence LLM tout en réduisant considérablement la consommation d’énergie.

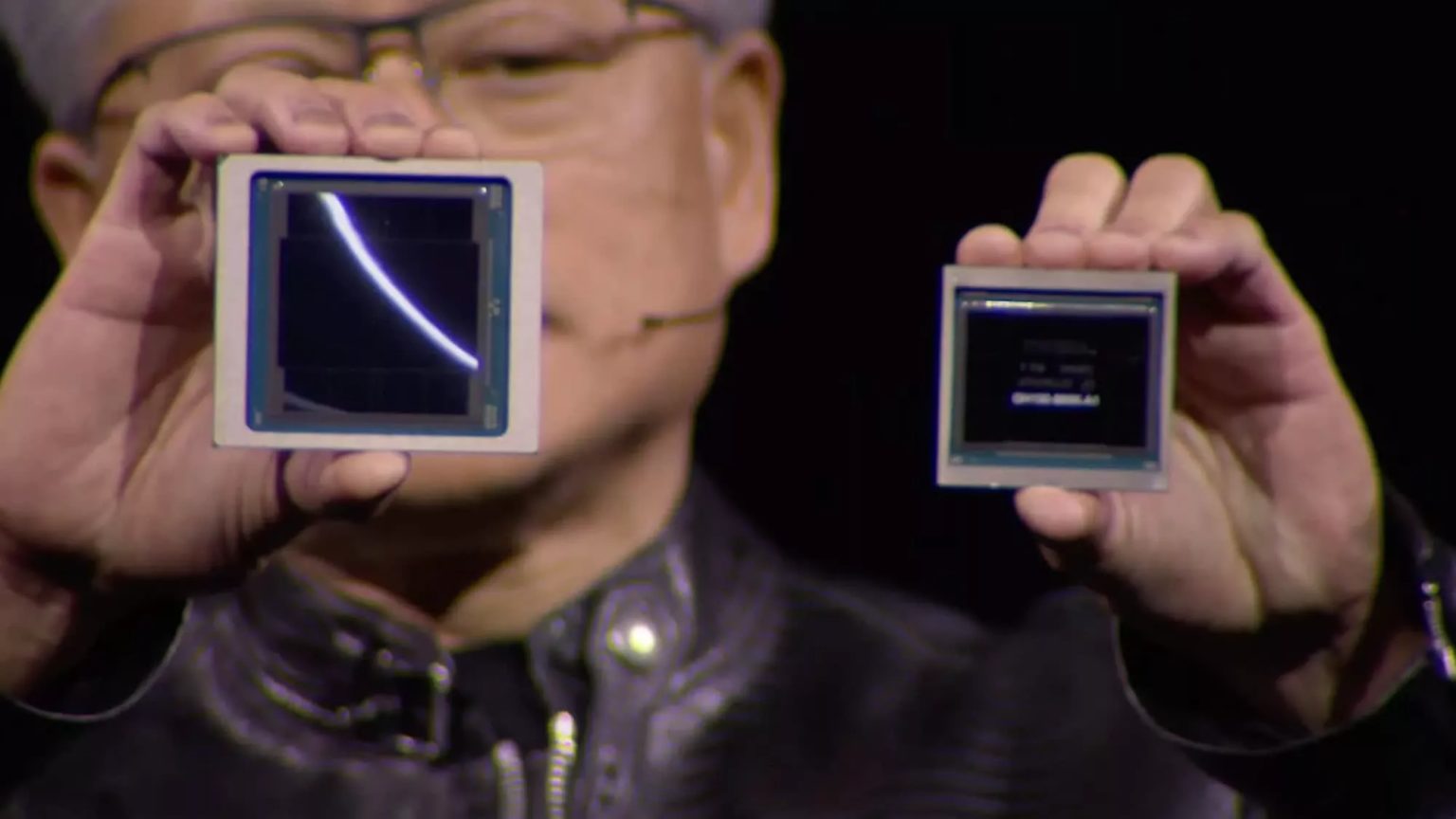

Le nouveau GPU Nvidia B200 contient 208 milliards de transistors et offre jusqu’à 20 pétaflops de performances FP4. Il comprend également un moteur de transformateur rapide de deuxième génération doté de la précision FP8. Le GB200 Grace combine deux de ces puces B200 avec un processeur Nvidia Grace et les connecte via une interface puce à puce (C2C) NVLink qui offre 900 Go/s de bande passante bidirectionnelle.

La société affirme que les nouveaux accélérateurs contribueraient à des percées dans le traitement des données, la simulation technique, la conception électronique, l’automatisation, la conception de médicaments assistée par ordinateur et l’informatique quantique.

Selon Nvidia, seuls 2 000 GPU Blackwell peuvent entraîner un LLM de 1,8 milliard de paramètres tout en ne consommant que quatre mégawatts d’énergie, alors qu’il aurait fallu auparavant 8 000 GPU Hopper et 15 mégawatts pour accomplir la même tâche.

La société affirme également que sur un benchmark GPT-3 LLM avec 175 milliards de paramètres, le GB200 offre des performances 7 fois supérieures à celles d’un H100 tout en offrant des performances d’entraînement 4 fois plus rapides. Les nouvelles puces peuvent potentiellement réduire les coûts d’exploitation et la consommation d’énergie jusqu’à 25 fois.

A lire aussi : Pas seulement le matériel : quelle est la profondeur du fossé logiciel de Nvidia ?

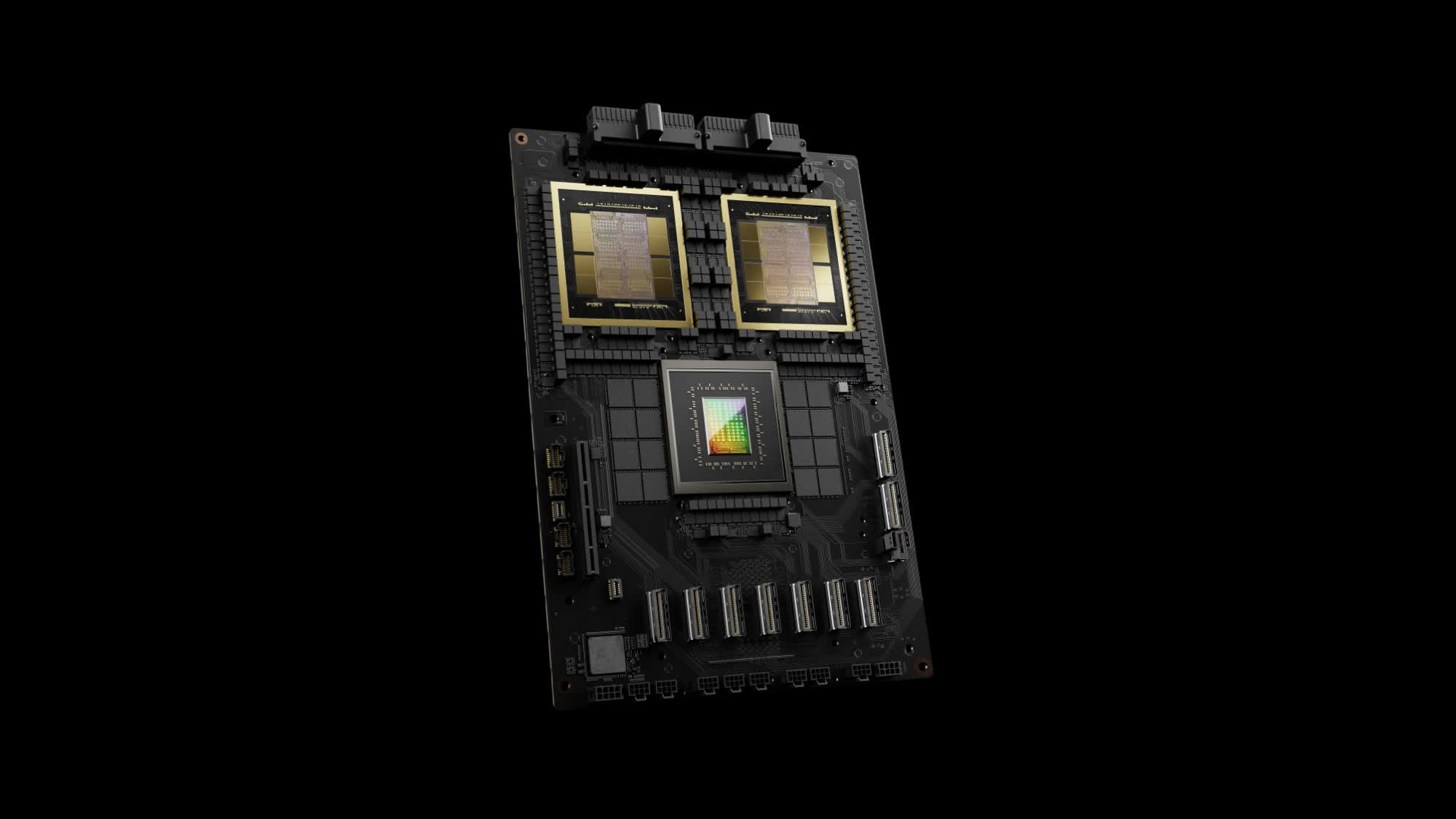

Parallèlement aux puces individuelles, Nvidia a également dévoilé un système multi-nœuds refroidi par liquide et à l’échelle du rack appelé GB200 NVL72 pour les charges de travail intensives en calcul. Il combine 36 superpuces Grace Blackwell, qui comprennent 72 GPU Blackwell et 36 processeurs Grace interconnectés par NVLink de cinquième génération.

Le système est livré avec 30 To de mémoire rapide et offre 1,4 exaflops de performances IA pour le dernier DGX SuperPOD. Nvidia affirme offrir 30 fois les performances d’un système H100 dans les applications gourmandes en ressources comme le paramètre 1,8T GPT-MoE.

De nombreuses organisations et entreprises devraient adopter Blackwell, et la liste comprend le who’s who virtuel de la Silicon Valley. Parmi les plus grandes entreprises technologiques américaines prêtes à déployer les nouveaux GPU figurent Amazon Web Services (AWS), Dell, Google, Meta, Microsoft, OpenAI, Oracle, Tesla et xAI, entre autres.

Malheureusement pour les passionnés de jeux, le PDG de Nvidia, Jensen Huang, n’a rien révélé ni fait allusion aux GPU de jeu Blackwell qui devraient être lancés plus tard cette année ou au début de 2025.

La gamme devrait être dirigée par la GeForce RTX 5090 alimentée par le GPU GB202, tandis que la RTX 5080 sera soutenue par le GB203.